(논문명) Task-Agnostic Undesirable Feature Deactivation Using Out-of-Distribution Data - <NeurIPS>

이재길 교수 제공

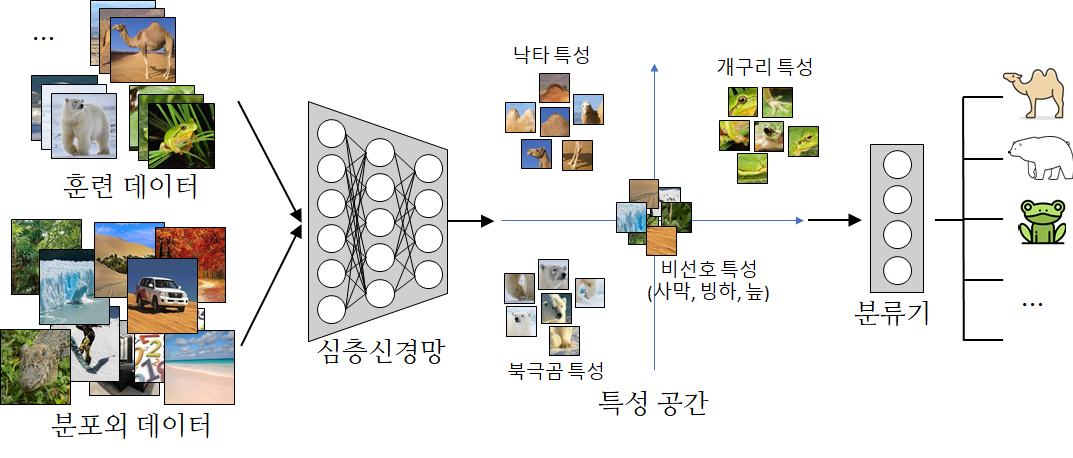

훈련 데이터와 분포 외 데이터를 입력받아 심층 신경망 훈련 과정에서 분포 외 데이터에서 추출된 비선호 특성은 영 벡터로 억제된다.

전산학부 이재길 교수 연구팀이 훈련 데이터가 적을 때에도 예측 정확도가 높은 새로운 모델 훈련 기술을 개발했다. 이 기술은 심층 학습(딥러닝) 모델의 훈련에서 바람직하지 않은 특성을 추출하는 것을 억제하여 적은 데이터에도 정확도를 높일 수 있게 하였다. 박동민 박사과정이 제1저자로 참여한 이번 연구는 <신경정보처리시스템학회(NeurIPS) 2021>에서 오는 12월 발표될 예정이다.

딥러닝 모델의 훈련은 어떻게 이루어지나

딥러닝 모델의 훈련은 주어진 훈련 데이터에서 레이블, 즉 정답과 관련성이 높은 특성들을 찾아내는 과정이라 볼 수 있다. 예시로, ‘낙타’의 주된 특성이 등에 혹이 있는 것임을 알아내는 것이 있다. 그러나 훈련 데이터가 충분하지 않을 경우 바람직하지 않은 특성들도 함께 추출될 수 있는데, 낙타의 배경으로 종종 사막이 나와 ‘사막’이 낙타의 특성으로 추출될 수도 있다는 것이다. 사막은 낙타의 고유 특성이 아니며, 이러한 데이터로 인해 사막에 있지 않은 낙타는 낙타로 인식하지 못하거나, 사막에 있는 다른 동물들을 낙타로 인식하는 문제가 생길 수 있다. 데이터가 충분하지 않을수록 이런 문제가 커져 바람직하지 않은 특성을 학습할 가능성이 커진다.

딥러닝 모델은 예측의 원인을 알기 힘들고, 데이터가 부족할 때는 사람에게는 풀기 쉬운 문제를 틀리기도 한다. 이번 연구를 통해 데이터가 적은 상황에서도 딥러닝 예측의 정확성과 일관성을 높이는데 사용될 수 있으며, 다양한 분야에서 딥러닝 모델의 신뢰도를 향상시킬 수 있을 것이다.

기존 연구는

바람직하지 않은 특성을 억제하기 위한 연구는 이전에도 존재하였으나, 대부분의 기존 연구는 그 활용도가 ‘분류’에 국한되었다. 이 연구에서는 모든 문제 형태에 사용되는 일반적인 딥러닝 모델을 다루고, 파라미터의 활성화를 억제하여 바람직하지 않은 특성을 억제한다. 따라서, 분류 문제를 넘어 다양한 형태의 문제에서 선호하지 않은 특성 억제 가능성을 보인다.

연구는 어떻게 진행되었나

연구팀은 바람직하지 않은 특성을 억제하기 위해 분포 외 데이터, 즉 훈련 데이터와 분포가 다른 데이터를 활용했다. 훈련 데이터에 존재하는 바람직하지 않은 특성이 분포 외 데이터에도 존재할 수 있다는 점에서 착안한 것이다. 예를 들어, 낙타와 호랑이 사진의 분류를 위한 훈련에서 여우 사진은 분포 외 데이터가 된다. 여우 사진의 배경으로도 사막이 나올 수 있는데, 즉 다량의 분포 외 데이터를 추가로 활용해 여기에서 추출된 특성은 영(0) 벡터가 되어 소멸하도록 훈련 과정을 규제했다. 이렇게 바람직하지 않은 특성의 효과를 억제하고, 연구팀은 이 정규화 방법론을 ‘비선호 특성 억제’라고 이름 붙였다. 분포 외 데이터는 레이블링을 요구하지 않아 상대적으로 수집이 쉬워 연구의 활용도가 기대된다. 또한, 이 방법은 문제의 형태에 제한되지 않고 적용할 수 있다는 장점이 있다.

이미지 데이터 분석의 세 가지 주요 문제, 이미지 분류 문제(classification), 객체 검출 문제(object detection), 객체 지역화 문제(object localization)에 적용한 결과, 기존의 최신 방법론과 비교했을 때 각각 최대 12%, 3%, 8%의 예측 정확도를 향상시킴을 확인하였다.

이 교수는 이 연구가 어떤 외부 데이터를 노출시키냐에 따라 성능 향상 정도가 달라지며, 어떤 외부 데이터가 현재 문제에서 비선호 특성을 억제하는데 가장 좋은지 사전에 알지 못한다는 한계점이 존재한다고 전했다. 향후 연구에서는 외부 데이터에 의존적이지 않고, 현재 모델의 성능을 향상시키는데 도움이 되는 비선호 특성을 가진 가짜 데이터를 생성하여 이를 억제하는 연구를 하고자 한다고 밝혔다.